揭秘神经网络GPU加速深度学习计算的利器

算法模型

2024-07-19 17:00

643

联系人:

联系方式:

随着人工智能和深度学习的飞速发展,神经网络已经成为了计算机科学领域的一个重要分支。而在这个过程中,GPU(图形处理器)扮演了一个不可或缺的角色。本文将深入探讨神经网络与GPU之间的紧密联系,以及GPU如何为神经网络提供强大的计算能力。

一、神经网络与GPU的渊源

神经网络是一种模拟人脑神经元结构的计算模型,它通过大量的神经元节点相互连接,实现对输入数据的复杂处理。然而,传统的CPU在处理这种大规模并行计算时显得力不从心,因为CPU的设计初衷是执行串行指令,而非并行计算。

此时,GPU的优势就显现出来了。GPU最初是为图形渲染而设计的,它能够同时处理成千上万的像素点,具有极高的并行计算能力。因此,当人们发现GPU可以用于加速神经网络的计算时,一场革命性的变革就此展开。

二、GPU在神经网络中的优势

- 并行计算能力

GPU拥有成百上千个核心,能够同时处理大量数据。这对于神经网络中需要处理的巨量数据和复杂的矩阵运算来说,无疑是一个巨大的优势。通过利用GPU的并行计算能力,神经网络的计算速度可以得到显著提升。

- 高效的内存访问

GPU通常配备有高速的显存,这使得它在处理大规模数据时具有更高的效率。GPU还支持直接内存访问(DMA)技术,可以直接从主内存中读取数据,进一步提高了数据传输的效率。

- 优化的数学库

为了充分发挥GPU的计算能力,许多厂商都提供了针对GPU优化的数学库,如NVIDIA的cuDNN(CUDA Deep Neural Network library)等。这些数学库针对神经网络中的常见操作进行了高度优化,使得GPU在执行这些操作时能够达到最佳性能。

三、GPU在神经网络中的应用实例

- 图像识别和处理

在图像识别和处理领域,神经网络已经成为一种主流的技术。例如,卷积神经网络(CNN)就是一种广泛应用于图像识别的神经网络模型。通过使用GPU加速计算,CNN可以在短时间内完成对大量图像的处理和分析,从而实现实时的图像识别功能。

- 自然语言处理

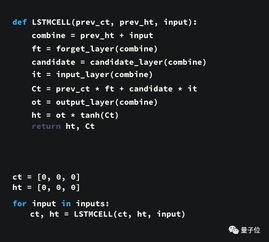

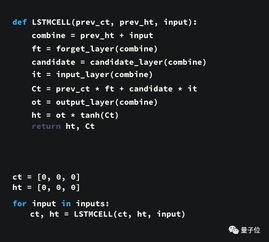

自然语言处理(NLP)是另一个受益于GPU加速的领域。循环神经网络(RNN)和长短时记忆网络(LSTM)等模型在NLP任务中表现出色,但它们需要处理的数据量和计算复杂性都非常高。借助GPU的强大计算能力,这些模型可以更快地训练和推断,从而提高NLP任务的效率和准确性。

四、展望未来:更强大的GPU助力神经网络发展

随着技术的不断进步,未来的GPU将会更加强大。一方面,硬件制造商将继续提升GPU的性能,增加更多的核心和更高的显存带宽;另一方面,软件开发者也将不断优化算法和编程模型,以更好地利用GPU的计算资源。这将使得神经网络能够在更短的时间内完成更复杂的任务,推动人工智能领域的进一步发展。

随着人工智能和深度学习的飞速发展,神经网络已经成为了计算机科学领域的一个重要分支。而在这个过程中,GPU(图形处理器)扮演了一个不可或缺的角色。本文将深入探讨神经网络与GPU之间的紧密联系,以及GPU如何为神经网络提供强大的计算能力。

一、神经网络与GPU的渊源

神经网络是一种模拟人脑神经元结构的计算模型,它通过大量的神经元节点相互连接,实现对输入数据的复杂处理。然而,传统的CPU在处理这种大规模并行计算时显得力不从心,因为CPU的设计初衷是执行串行指令,而非并行计算。

此时,GPU的优势就显现出来了。GPU最初是为图形渲染而设计的,它能够同时处理成千上万的像素点,具有极高的并行计算能力。因此,当人们发现GPU可以用于加速神经网络的计算时,一场革命性的变革就此展开。

二、GPU在神经网络中的优势

- 并行计算能力

GPU拥有成百上千个核心,能够同时处理大量数据。这对于神经网络中需要处理的巨量数据和复杂的矩阵运算来说,无疑是一个巨大的优势。通过利用GPU的并行计算能力,神经网络的计算速度可以得到显著提升。

- 高效的内存访问

GPU通常配备有高速的显存,这使得它在处理大规模数据时具有更高的效率。GPU还支持直接内存访问(DMA)技术,可以直接从主内存中读取数据,进一步提高了数据传输的效率。

- 优化的数学库

为了充分发挥GPU的计算能力,许多厂商都提供了针对GPU优化的数学库,如NVIDIA的cuDNN(CUDA Deep Neural Network library)等。这些数学库针对神经网络中的常见操作进行了高度优化,使得GPU在执行这些操作时能够达到最佳性能。

三、GPU在神经网络中的应用实例

- 图像识别和处理

在图像识别和处理领域,神经网络已经成为一种主流的技术。例如,卷积神经网络(CNN)就是一种广泛应用于图像识别的神经网络模型。通过使用GPU加速计算,CNN可以在短时间内完成对大量图像的处理和分析,从而实现实时的图像识别功能。

- 自然语言处理

自然语言处理(NLP)是另一个受益于GPU加速的领域。循环神经网络(RNN)和长短时记忆网络(LSTM)等模型在NLP任务中表现出色,但它们需要处理的数据量和计算复杂性都非常高。借助GPU的强大计算能力,这些模型可以更快地训练和推断,从而提高NLP任务的效率和准确性。

四、展望未来:更强大的GPU助力神经网络发展

随着技术的不断进步,未来的GPU将会更加强大。一方面,硬件制造商将继续提升GPU的性能,增加更多的核心和更高的显存带宽;另一方面,软件开发者也将不断优化算法和编程模型,以更好地利用GPU的计算资源。这将使得神经网络能够在更短的时间内完成更复杂的任务,推动人工智能领域的进一步发展。